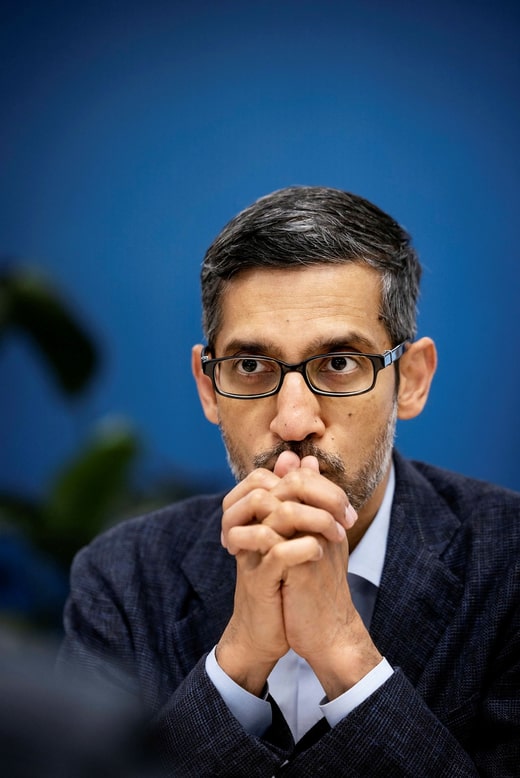

Sundar Pichai sait qu’il est intimidé. Mais pas en tant que personne.

Pour le PDG de l’une des plus grandes entreprises de la planète, et peut-être de l’entreprise technologique la plus puissante, il est étonnamment discret. Il ne s’agit pas d’un chef d’entreprise américain qui a la langue bien pendue, mais plutôt d’un intello. Vêtu d’une chemise et d’une veste bleu clair, il se rend pour la première fois en Suède pour – il est difficile de choisir un autre mot – prêcher en faveur de l’intelligence artificielle.

– Compte tenu du caractère perturbateur de l’intelligence artificielle, il est naturel d’avoir peur, déclare Sundar Pichai.

Et, selon lui, cette peur peut être une bonne chose. Elle peut nous apprendre à prendre les dangers au sérieux et à gérer l’IA de manière plus sûre.

L’intelligence artificielle est un défi, en particulier pour la sécurité – les enjeux sont tellement plus importants.

Dans la salle du Royal Institute of Technology University, où Sundar Pichai s’exprime, elle est bondée. Les étudiants sont assis sur les chaises alignées, mais d’autres sont tombés sur le code QR vérifié à l’entrée et les gens affluent maintenant le long des murs.

Sundar Pichai entre, salue poliment et s’entretient pendant près d’une heure avec Danica Kragic, professeur à la KTH. Elle est généralement appelée professeur de robotique et soulève la question du contrôle des systèmes physiques – pensez aux robots – à l’aide de l’IA. Un défi, admet Sundar Pichai.

– Surtout en matière de sécurité. Les enjeux seront tellement plus importants.

Photo : Lotta Härdelin

Nous nous retrouvons ensuite pour une interview. Il nous dira comment il voit l’explosion de l’IA, comment il craint de perdre le contrôle des systèmes hyperintelligents et comment il est critiqué par son propre scientifique vedette. Mais aussi comment tout a commencé avec des photos de chats.

C’était l’automne dernier lorsque le chatbot Chat GPT a bouleversé l’internet. Parmi les experts en IA, il était bien connu que la minuscule, minuscule (à peine 400 employés) Open AI avait développé GPT, une IA de langage qui avait une étonnante capacité à créer du texte à un niveau presque humain. Répondre à des questions, improviser et converser. Aujourd’hui, le public y a accès et le monde entier en reste bouche bée.

Google est ébranlé. L’entreprise considérée comme un leader mondial devait soudain rattraper son retard. Il a été rapporté que la direction a émis un « code rouge », un ordre sévère d’accélérer le rythme, d’intégrer l’IA partout et de montrer l’exemple (Sundar Pichai n’a jamais utilisé ce terme lui-même, dit-il).

« Les modèles d’IA avaient des problèmes – nous voulions donc aller plus loin avant de les publier »

En mai, la conférence annuelle de Google s’est tenue dans la Silicon Valley. Chatbots d’IA, assistance à la rédaction d’IA dans les logiciels de messagerie, IA pour les programmeurs et pour les médecins. L’IA partout.

– Nous savions que ces modèles d’IA présentaient des problèmes, et c’est toujours le cas. Nous voulions donc progresser avant de les diffuser », explique Sundar Pichai.

Lorsque l’intérêt pour Chat GPT a explosé, il est généralement considéré comme le service internet à la croissance la plus rapide de tous les temps, Google n’a pas pu attendre pour sortir son concurrent.

– Nous étions déjà sur le point de le faire. Cela nous a donné encore plus d’énergie et d’urgence.

Photo : Lotta Härdelin

Il a été indéniablement Ces derniers mois, l’IA s’est indéniablement transformée en un véritable Far West. Des utilisateurs ont vu Chat GPT mentir et inventer des histoires, des étudiants se sont fait prendre avec des devoirs rédigés par l’IA, et des images d’IA ont trompé des salles de presse. Microsoft a intégré Chat GPT dans le moteur de recherche Bing, il s’est avéré être lunatique et a grondé les gens.

Mais Bing est un moteur de recherche presque dénué de sens. Chat GPT est largement utilisé comme un jouet. En revanche, des milliards de personnes utilisent Google chaque jour. Si un système d’IA incontrôlé devait y jouer, les conséquences seraient difficiles à prévoir.

– C’est pourquoi nous devons être plus prudents », a déclaré Sundar Pichai.

L’histoire dira si l’offensive de Google en matière d’IA est suffisamment prudente. Ce qui est clair, c’est qu’il s’agit d’un moment décisif pour Sundar Pichai, qui a tout misé sur l’IA. Cela a commencé bien avant le battage médiatique d’aujourd’hui.

En 2012 Google a mené une expérience. Elle s’est déroulée dans les locaux de Google X, le laboratoire secret qui a mené des recherches dans tous les domaines, des voitures autonomes aux ballons stratosphériques. 16 000 ordinateurs ont été reliés entre eux, pointés sur YouTube, et un logiciel appelé « réseau neuronal profond » a été lancé. Il s’agit d’un programme informatique inspiré du cerveau humain qui, selon les théories, est capable de faire des choses pour lesquelles l’intelligence humaine est nécessaire.

Trois jours ont passé. Puis le programme a commencé à reconnaître des chats. Et ce, simplement en « regardant » d’énormes quantités de photos et de vidéos, personne n’ayant dit au logiciel à quoi ressemble habituellement un chat.

– À ce moment-là, lorsqu’il a reconnu un chat, j’ai réalisé à quel point nous avions progressé », explique Sundar Pichai.

Photo : Alexander Mahmoud, Leif R Jansson/TT

Aujourd’hui, ces technologies sont dans tous les téléphones portables modernes. En 2012, c’était quelque peu révolutionnaire. Non pas que reconnaître les chats soit si important, mais cela prouvait que la technologie avait la capacité de faire des choses que seuls les cerveaux biologiques pouvaient faire auparavant.

Aujourd’hui, lorsque l’on parle d’IA, on fait généralement référence à une version de ces réseaux neuronaux profonds. Le département qui a réalisé l’expérience a reçu un nom à forte connotation : Google Brain.

Trois ans après l’expérience du chat, Sundar Pichai a été nommé PDG de Google alors que les fondateurs prenaient du recul. L’une de ses premières grandes décisions a été de faire de Google une entreprise spécialisée. « AI first company »une entreprise où l’IA est mise au premier plan.

Dans les années qui ont suivi, un certain nombre de percées ont été réalisées, et Google et sa filiale Deepmind ont joué un rôle dans nombre d’entre elles.

Si Google a été critiqué dans les milieux de l’IA, ce n’est pas parce que la recherche était faible, mais parce que l’entreprise, avec ses vastes ressources, a aspiré tous les chercheurs talentueux en IA et est devenue trop dominante. Pourtant, ce n’est pas Google qui a dominé le monde de l’IA cet hiver.

Photo : Lotta Härdelin

Aujourd’hui, tout le monde peut peut rechercher des chats sur ses propres photos, ce qui nécessitait d’énormes ressources en 2012. Mais vous ne pouvez pas rechercher des gorilles. Cela peut sembler étrange : une IA ne devrait pas avoir plus de difficultés à reconnaître un primate qu’un chat. Mais le fait est que Google a bloqué le mot « gorille ». La raison de ce blocage illustre bien les risques liés aux systèmes d’IA actuels.

En 2015, l’application Google Photos a commencé à identifier des personnes noires comme étant des gorilles. Des captures d’écran montrant des photos d’un jeune homme et d’une jeune femme noirs regardant l’appareil photo, automatiquement étiquetées « gorilles », ont commencé à se répandre.

Personne ne croit que les programmeurs racistes de Google l’ont fait délibérément. Mais il s’agit probablement d’un exemple de la partialité et des préjugés dont font parfois preuve les systèmes d’intelligence artificielle.

Lorsque le système a été entraîné à reconnaître des images, il a analysé d’énormes quantités d’images, appelées données d’entraînement. Parmi elles, il y avait probablement plus de personnes blanches que de personnes noires. Par conséquent, l’IA a de moins en moins bien reconnu les Noirs, au point de les mettre dans le même sac que les gorilles.

Photo : Lotta Härdelin

Huit ans plus tard, Google photos bloque toujours les recherches de gorilles. Le risque est trop grand, a récemment annoncé l’entreprise. Des blocages similaires ont été détectés dans les systèmes d’Apple, de Microsoft et d’Amazon.

Dans ce contexte, je demande à Sundar Pichai quels sont les risques liés à l’IA qu’il considère comme les plus urgents à résoudre.

Nous devons nous inquiéter à long terme des systèmes potentiellement très puissants, si nous pouvons les contrôler.

– À court terme, par exemple, la désinformation. Deepfakes (fausses vidéos), matériel artificiel dont les gens ne se rendent pas compte qu’il est artificiel. Comment l’arrêter ? Certains systèmes auront ces biais, si nous les démarrons sans les comprendre, c’est un risque.

Nous abordons ensuite les risques futurs.

– À plus long terme, nous devons nous préoccuper des systèmes potentiellement très puissants, si nous pouvons les contrôler et les aligner sur ce que nous voulons en tant que société.

C’est vraiment quelque chose d’extraordinaire d’entendre la personne peut-être la plus puissante au monde dans le domaine de l’intelligence artificielle. Oui, Sundar Pichai revient sans cesse sur la manière dont l’IA peut aider l’humanité, et l’a déjà fait : l’année dernière, une initiative de Google a permis d’achever en quelques semaines quelques centaines de millions d’années de travail humain dans le domaine de la recherche biologique (les curieux peuvent consulter le projet AlphaFold sur n’importe quel moteur de recherche).

Photo : Lotta Härdelin

Il n’en reste pas moins que nous développons des systèmes géants dotés de capacités extrêmes dont nous ne connaissons pas vraiment le fonctionnement. Dans la recherche sur l’IA, on appelle cela le problème de la boîte noire : une fois qu’un système d’IA a appris une tâche, la solution est si complexe que nous ne comprenons pas comment il l’accomplit.

Devrions-nous libérer des systèmes que nous ne comprenons pas vraiment ? Sundar Pichai hésite un instant avant de répondre. Il est clair que la question est sérieuse pour lui.

– Je pense que cela dépend du domaine d’utilisation. Vous devez estimer le risque pour chaque contexte. S’il s’agit d’un système qui prend des décisions où les enjeux sont importants, alors ce n’est probablement pas bon. Mais il faut toujours mettre en balance les risques et les avantages. Il n’y a pas de réponse unique pour toutes les situations. Dans certains cas, c’est tout à fait normal, par exemple si j’écris un courriel dans Gmail et qu’il me suggère une réponse que je peux modifier et décider d’envoyer ou non.

Ces questions ne relèvent pas de la technologie et ne peuvent être tranchées par des ingénieurs ou des techniciens.

– Nous avons des spécialistes des sciences sociales et des philosophes dans notre équipe. En fin de compte, cela ne dépend pas d’une seule entreprise », déclare Sundar Pichai.

Photo : Lotta Härdelin

Les critiques n’ont pas manqué. Tout d’abord, des milliers de chefs d’entreprise, d’ingénieurs et de scientifiques – dont Elon Musk – ont signé une pétition appelant à une pause de six mois dans le développement de systèmes d’IA plus puissants, une demande qui n’a aucune chance d’aboutir.

Mais l’inquiétude est aussi à l’intérieur de Google.

Geoffrey Hinton est l’un d’entre eux. Ce n’est pas n’importe qui dans le domaine de l’IA – ce sont ses recherches dans les années 1980 qui ont jeté les bases des systèmes d’IA qui ont tant impressionné Sundar Pichai en 2012.

Je suis heureux que Jeff parle de ses préoccupations. Beaucoup le partagent, y compris d’autres sur Google

Récemment, Geoffrey Hinton a pris sa retraite de Google pour pouvoir mettre en garde contre les dangers de l’IA.

En fait, ce n’est pas Google qu’il critique, son ancien employeur a fait beaucoup de choses bien, dit-il. Mais l’évolution fulgurante de la société l’effraie. La vision d’une superintelligence artificielle complète, capable de surpasser toutes les capacités mentales humaines, n’est peut-être pas si éloignée.

Photo : Julian Simmonds/Shutterstock

Geoffrey Hinton en train de parler littéralement sur les robots tueurs et ce qu’ils signifieraient entre les mains de quelqu’un comme Vladimir Poutine.

Il a déclaré dans des interviews qu’il regrettait en partie le travail de sa vie. Que pense Sundar Pichai des critiques de Hinton, qu’il appelle affectueusement « Jeff » ?

– Il y a toujours eu des scientifiques qui font entendre leur voix et s’inquiètent de ce sur quoi ils travaillent. Prenez la génétique ou la recherche nucléaire par exemple. Je n’ai que du respect et de l’admiration pour Jeff et son important travail dans ce domaine. Je suis heureux qu’il fasse part de ses préoccupations. Beaucoup de gens le partagent, y compris d’autres personnes chez Google.

À long terme, nous aurons des systèmes superintelligents dotés de très grandes capacités.

Partagez-vous ce point de vue ?

– J’ai toujours pensé que l’IA est une technologie très puissante qui nous inquiète. À long terme, nous aurons des systèmes superintelligents dotés de très grandes capacités. Et nous devons vraiment les développer pour qu’ils fassent du bien aux gens et à la société, oui.

Il existe un mot pour désigner la technologie d’IA la plus puissante : AGI, « artificial general intelligence » – une intelligence qui n’est pas conçue pour une seule chose (traduire un texte, créer des images, trouver des tumeurs dans des radiographies…), mais qui est intelligente de manière générale. Comme un cerveau. Une telle IA serait capable d’agir de manière plus indépendante, de penser librement et de trouver ses propres solutions aux problèmes.

Les systèmes d’IA actuels n’en sont pas là. Mais Deepmind voulait y parvenir, c’était un objectif déclaré. Open AI, l’entreprise derrière Chat GPT, aussi.

Mais au fur et à mesure que Deepmind et Google ont progressé et que les yeux du monde se sont tournés vers eux, l’objectif a été atténué. Quelle est la prochaine étape ? Google a-t-il l’intention de créer un AGI ? Sundar Pichai rejette la question, l’AGI n’est pas définie et « ce n’est pas ainsi que nous l’envisageons ».

C’est une réponse, mais ce n’est pas un non.

Dans la version AI du moteur de recherche de Google, vous pouvez obtenir une réponse à une question, au lieu d’une liste de liens. Dites-leur que vous voyagez à Milan et ce que vous aimez. La réponse sera un petit guide de voyage personnalisé. Et ainsi de suite.

Pour l’instant, cette version du moteur de recherche n’a pas été diffusée au grand public. Mais elle est construite. Et elle ne pourrait pas exister s’il n’y avait pas un fait : Google a utilisé l’ensemble du web ouvert pour entraîner son modèle d’IA à comprendre comment les gens parlent, pensent et raisonnent.

Si vous avez publié un poème sur un blog, écrit sur un forum de discussion, géré un site web sur les chiens – eh bien, votre texte a probablement été introduit dans cette IA en tant que données d’entraînement.

Photo : Lotta Härdelin

Faits.Sundar Pichai

Né en 1972 en Inde. Sa famille n’avait ni voiture ni télévision, selon le journal indien Mumbai Mirror. Ce n’est qu’à l’âge de 12 ans que Sundar Pichai a reçu un téléphone.

Connaissances de l’époque le décrivent comme un « garçon timide et tranquille qui aimait la science ».

Il a rejoint Google en 2004où il a été responsable du développement du navigateur Chrome et du système d’exploitation mobile Android.

En 2015 il est devenu PDG de Google. Sergey Brin et Larry Page, qui ont fondé l’entreprise en 1998, ont pris du recul mais ont conservé le contrôle par l’intermédiaire de leur société mère Alphabet.

Depuis 2019 Sundar Pichai est également le PDG d’Alphabet. Avec les fondateurs, il forme le comité exécutif du conseil d’administration.

Bien sûr, Google a indexé le web depuis sa création, mais dans le but de créer des liens vers le site indexé. Ici, l’objectif est de créer une IA, propriété de Google, basée sur la somme des activités humaines sur le web.

– Étant donné que nous sommes très tôt dans le développement de la technologie, nous ne pouvons pas dire que nous avons toutes les réponses, nous ne faisons pas de suppositions sur ce qui est juste », a déclaré Sundar Pichai.

Il ajoute qu’il est important de respecter les droits des créateurs et de travailler avec différentes parties pour trouver les bonnes voies.

Mais les modèles d’IA existent déjà, et ils sont entraînés ?

– C’est vrai. Aujourd’hui, nous les entraînons sur ce qui est accessible au public.

Et vous ne demandez pas spécifiquement la permission ?

– D’une certaine manière, nous le faisons », déclare Sundar Pichai, en faisant référence aux caractéristiques techniques qu’un site web peut avoir pour empêcher les moteurs de recherche de les ajouter.

– Mais c’est collectivement que nous devons trouver les réponses. Nous participerons à la discussion et trouverons la bonne approche au fil du temps.

La question est loin d’être évidente. Lorsque je lis les textes des autres, ma façon d’écrire est affectée. Lorsque je vois des illustrations, ma façon de dessiner peut changer. Personne ne dirait que je dois demander la permission pour cela, tant que je ne plagie pas directement.

Mais si une machine fait la même chose ?

Photo : Lotta Härdelin

L’un des orateurs à la conférence Google de cette année dans la Silicon Valley était James Manyika. Il porte le titre un peu étrange de « responsable de la technologie et de la société », et son intervention a principalement porté sur la manière dont la technologie de Google ne devrait pas être utilisée.

Il a fait la démonstration d’une traduction automatique à partir d’une vidéo. Vous partez d’une conférence universitaire filmée, un programme transcrit ce qui est dit, le traduit dans une nouvelle langue, crée une voix synthétique qui lit le texte traduit. Ensuite – et c’est là que ça devient spécial – les mouvements des lèvres dans la vidéo sont modifiés pour correspondre à la nouvelle langue.

Ainsi, un professeur d’université peut s’exprimer dans sa langue maternelle et le même enseignement peut être dispensé dans toutes les langues traduites par Google, soit actuellement 133.

C’est aussi une technique parfaite pour la désinformation et la propagande, en créant des vidéos où n’importe qui semble pouvoir dire n’importe quoi. Ces vidéos, connues sous le nom de « deepfakes », sont déjà une réalité.

Photo : Lotta Härdelin

Il y a quelque temps un site d’information ukrainien a été piraté et un faux film a été publié dans lequel le président Zelenskyj semblait appeler ses concitoyens à déposer les armes. Cette vidéo était amateur, mais des outils tels que Google pourraient la rendre plus soignée.

C’est pourquoi seules des universités sélectionnées devraient être autorisées à l’utiliser.

C’est ce qu’on entend souvent de la part de Google aujourd’hui : L’entreprise souligne que les systèmes de reconnaissance faciale n’existent pas en tant que service commercial. Une fonction de clonage de voix nécessite l’autorisation de la personne derrière la voix.

En huit heures, AlphaGO peut apprendre à battre n’importe quel être humain à partir de rien.

Qu’il s’agisse de relations publiques ou d’une véritable attention, il s’agit d’un changement par rapport à ce que les grandes entreprises technologiques avaient l’habitude de dire. Il fut un temps où Mark Zuckerberg avait pour devise de faire avancer Facebook rapidement et de casser les choses.

– Nous avons affaire à une technologie qui peut développer des capacités très, très rapidement. Nous l’avons vu avec AlphaGo (une IA qui a battu en 2016 le champion de l’ancien jeu de Go, ndlr) : en huit heures, elle pouvait apprendre à partir de rien pour battre n’importe quel humain. Il est donc important de comprendre le pouvoir de la technologie et la manière dont elle peut être utilisée à mauvais escient », déclare Sundar Pichai.

Mais qu’est-ce qu’un abus ? Jusqu’à récemment, Google personnalisait des systèmes d’IA pour les compagnies pétrolières et gazières. Dans sa publicité destinée aux entreprises de combustibles fossiles, Google se vantait de les aider à « trouver et évaluer les gisements de pétrole plus rapidement ».

En 2020, Google a promis de cesser cette activité. Existe-t-il d’autres secteurs qui ne devraient pas avoir accès à la technologie ?

– Par exemple, nous ne voudrions absolument pas soutenir la surveillance en violation des droits de l’homme, nous dirions non. Cela dépend donc de l’utilisation dans chaque cas », a déclaré Sundar Pichai.

Militaire, fabrication d’armes ? Pas si « le seul but était de vendre des armes d’une manière qui viole les droits de l’homme », répond-il. Google a déjà renoncé à des missions militaires à la suite de protestations de ses employés, mais l’année dernière, il a commencé à se préparer à faire du Pentagone un de ses principaux clients.

Dix ans seulement se sont écoulés entre le moment où les ordinateurs de Google X ont appris à reconnaître les chats et celui où les étonnants systèmes d’IA d’aujourd’hui ont été mis en ligne. Avant que Sundar Pichai ne se précipite dans une discrète camionnette noire aux vitres teintées, entouré de son entourage, je lui demande une prévision impossible : que verrons-nous dans cinq ans ?

– Je pense vraiment que nous aurons des modèles plus sophistiqués, capables de gérer de nombreux types de médias, d’utiliser des outils, de planifier et d’avoir une mémoire. Nous assisterons à une telle évolution, vers des systèmes que nous considérons comme plus intelligents. Espérons que nous aurons également fait des progrès pour qu’ils comprennent mieux le monde qui les entoure.

Seront-ils plus intelligents que nous ?

– Je pense que ce n’est pas la bonne façon de comparer. Imaginez un système capable de parler un millier de langues. Cela pourrait nous être utile. Mais pourquoi une personne apprendrait-elle mille langues ? Ce ne serait pas la meilleure façon d’utiliser notre temps. Je pense donc qu’il faut envisager les choses différemment. Mais vous savez. Dans certains domaines, ils auront une super intelligence.

Lire la suite :

Bientôt, l’IA pourra prédire si vos plaques d’athérome vous causeront une crise cardiaque

Les scientifiques mettent en garde contre la menace de l’IA et veulent suspendre son développement

L’IA va-t-elle prendre nos emplois ? Comment quatre professions vont changer

Liste.Commande

AI. L’intelligence artificielle est un terme générique qui désigne les technologies permettant d’effectuer des tâches qui nécessiteraient autrement l’intelligence humaine. Il peut s’agir de plusieurs types de technologies, mais généralement d’une forme d’apprentissage automatique où les ordinateurs sont entraînés à trouver eux-mêmes des solutions aux problèmes.

Apprentissage en profondeur. Une forme d’apprentissage automatique qui joue un rôle important dans les percées de l’IA que nous observons aujourd’hui. L’apprentissage en profondeur se fait à plusieurs niveaux, ce qui s’est avéré efficace pour les tâches complexes et abstraites. Comprendre ce que représente une image ou analyser le message d’un texte, par exemple.

AGI. Intelligence artificielle générale ». Les systèmes d’IA actuels sont très performants pour des tâches spécifiques, telles que l’identification ou la création d’images, le résumé de textes ou l’aide aux chercheurs dans des tâches difficiles. Mais ils ne sont pas intelligents de manière générale, comme un être humain. Si une IA générale est développée, elle pourrait prendre en charge n’importe quelle tâche. La question de savoir quand, ou si, nous pourrons créer une IAG est débattue.

GPT. Le système d’IA sur lequel repose le célèbre chatbot Chat GPT est essentiellement un modèle de langage, qui a été entraîné sur d’énormes quantités de texte et a appris à reconnaître des modèles. Il est ainsi capable d’interpréter des instructions et de produire lui-même du texte. GPT a été développé par la société Open AI à San Francisco.

Chatbot. Il ressemble à un chat ordinaire, mais le répondant est un système d’intelligence artificielle sous-jacent. Chat GPT et l’équivalent Bard de Google sont deux variantes liées à leurs principaux modèles linguistiques sous-jacents.

Podd.Comment le prodige de la technologie a laissé le canard de l’IA sortir de la bouteille

Écoutez le podcast Spotlight de DN, qui explique comment l’Open AI de Sam Altman a déclenché l’explosion actuelle de l’IA.

POINT DE VUE

Sam Altman, prodige de la technologie – comment il a laissé le canard de l’IA sortir de la bouteille

Erik est né et a grandi à Stockholm, en Suède, où il a passé la majeure partie de sa vie avant de venir vivre en France en 2018. Il est de langue maternelle suédoise et parle couramment francais. Il a obtenu un diplôme en communication et marketing à l’Université de Stockholm. Passioné par les voyages et la culture Suédoise, il aime partager les infos et valeurs de la Suède.