Il y a plus de deux ans, lorsque la Commission européenne a présenté sa proposition sur la manière de réglementer l’IA, appelée AI Act, les chatbots n’existaient pas de la même manière qu’aujourd’hui. Les progrès de l’intelligence artificielle sont rapides.

Les institutions européennes et les États membres s’efforcent de se mettre d’accord sur des lois susceptibles d’arrêter les ramifications sur le marché et de protéger les citoyens, sans pour autant étouffer le développement de l’IA en Europe.

L’un des principaux points de désaccord est de savoir si les systèmes d’IA peuvent être utilisés dans les lieux publics – rues, places, transports publics, etc. – et cartographier les personnes en temps réel grâce à la reconnaissance faciale. Il existe un large consensus sur le fait que l’Europe ne doit pas devenir comme la Chine. Dans ce pays, l’État peut enregistrer si les résidents brûlent un feu rouge à un passage pour piétons et noter les individus.

La proposition de la Commission européenne consiste en une interdiction générale de la reconnaissance faciale, assortie d’exceptions occasionnelles. Par exemple, pour rechercher des enfants disparus ou pour effectuer des recherches en cas d’attaques terroristes.

Photo : Sachelle Babbar/TT

L’Allemagne, avec son histoire de surveillance par le service de sécurité Stasi, s’y oppose. Elle souhaite une interdiction totale de la surveillance de masse en temps réel. La France a un point de vue différent. En mars, le Parlement a décidé que l’IA pouvait être utilisée pour la surveillance de masse pendant les Jeux olympiques d’été de 2024 à Paris.

Une majorité d’eurodéputés au Parlement européen, de la gauche à une partie du groupe libéral, ont la même position que l’Allemagne. Ils veulent une interdiction totale de la reconnaissance faciale dans les lieux publics. Le plus grand groupe de partis du Parlement, le PPE, qui comprend le M et le KD, a jusqu’à présent eu une opinion dissidente. Il souhaite autoriser les autorités chargées de l’application de la loi à utiliser la reconnaissance faciale dans des cas individuels.

Lorsque les pays de l’UE ont défini leur position sur la loi sur l’IA lors du Conseil des ministres de décembre, ils ont opté pour cette dernière ligne de conduite. L’Allemagne a publié une déclaration écrite pour souligner sa position.

Aujourd’hui, jeudi, deux commissions du Parlement européen voteront sur la loi sur l’IA. Les négociations se poursuivent jusqu’à la dernière minute entre les groupes politiques. A l’heure où nous écrivons ces lignes, de nombreux éléments indiquent que l’approche d’une interdiction totale de la surveillance de masse est en train de l’emporter.

En général, le Parlement européen a a une approche plus stricte de l’IA que les autres institutions de l’UE.

– Nous sommes assez loin du Conseil des ministres, par exemple en termes de droits de l’homme fondamentaux », déclare Brando Benifei, socialiste italien et principal négociateur de la loi sur l’IA au sein de la commission du marché intérieur du Parlement.

Photo : Philippe Stirnweiss/Parlement européen

Il mentionne que le Parlement a ajouté plusieurs domaines à la proposition de la Commission où il estime que l’IA devrait être totalement ou partiellement interdite. L’un de ces domaines est la cartographie des émotions des employés.

– Par exemple, si un employé est en colère ou nerveux devant son écran. Il s’agit d’une atteinte à la vie privée », déclare M. Benifei.

Il ne pense pas que des règles trop strictes étoufferont le développement de l’IA en Europe au profit de la Chine et des États-Unis, par exemple.

– Nous sommes convaincus que l’Europe peut être compétitive tout en préservant notre modèle social, tel que le respect des droits fondamentaux, la santé et la sécurité et une protection élevée des consommateurs », déclare Brando Benifei.

Le modéré suédois Arba Kokalari est membre de la même commission que Mme Benifei. Elle craint que l’UE ne soit distancée si la loi sur l’IA est trop stricte et détaillée.

– La position du Parlement signifie que nous nous dirigeons vers une loi sur la consommation plutôt que de décider des règles du jeu pour l’IA », déclare Arba Kokalari.

Photo : Alexis Haulot/Parlement européen

Elle souligne que les développements de l’IA sont si rapides qu’il est difficile de promulguer aujourd’hui une loi qui sera pertinente dans quelques années. Elle compare cela à une loi européenne récente qui existe pour les médias sociaux, entre autres.

– Une législation a été nécessaire après quelques années, lorsque nous avons eu le sentiment que nous ne pouvions pas faire confiance à Facebook, Google et d’autres pour supprimer les contenus illégaux. Le contenu des médias sociaux était devenu une sorte de Far West », explique Arba Kokalari.

Mais l’IA ne doit-elle pas être réglementée précisément pour éviter le Far West ?

– Oui, mais il s’agit toujours d’un exercice d’équilibre. Vous pouvez tester si d’autres législations fonctionnent pour l’IA. Et l’IA est déjà utilisée partout, par exemple pour diagnostiquer le cancer du sein à partir d’images de mammographie ou pour mesurer les émissions de carbone en temps réel. Nous voulons encourager le développement de la technologie », ajoute-t-elle.

Professeur Virginia Dignum de l’université d’Umeå, en Suède, estime qu’il est important de réglementer l’IA. Elle a fait partie d’un groupe d’experts qui a conseillé la Commission européenne avant qu’elle ne fasse sa proposition et demande des lois générales qui réglementent quand, comment et qui peut développer les systèmes, dans quelles conditions et quelles sont les responsabilités.

Virginia Dignum critique l’approche de la Commission européenne.

– Comme le processus législatif est lent par nature, nous avons besoin de règles qui dureront dans le futur. Vous ne pouvez pas contrôler certaines technologies. Les lois devraient être basées sur les conséquences de la technologie et les risques encourus, qu’elle s’appelle IA ou autre chose.

Photo : Mattias Pettersson/Université d’Umeå

Elle estime que la proposition de la Commission pourrait entraver l’innovation et les avantages que l’IA peut apporter aux citoyens et aux entreprises européennes.

– La réglementation devrait soutenir l’innovation afin que nous obtenions les systèmes dont nous avons réellement besoin », dit-elle, citant l’exemple de l’industrie automobile qui a développé le traitement catalytique des gaz d’échappement lorsqu’il a été exigé pour réduire les émissions.

De l’interdiction totale à l’inaction : voici comment l’UE veut réglementer l’IA et comment cela vous affecte

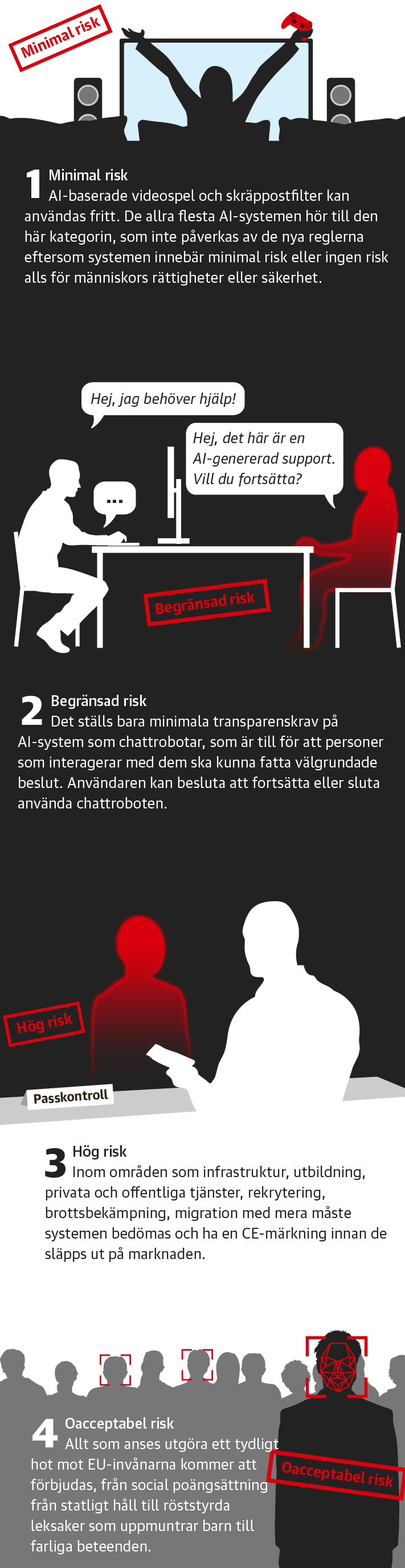

L’intelligence artificielle (IA) engendre des risques liés à la sécurité et aux droits fondamentaux des utilisateurs. Pour les protéger, la Commission européenne a proposé de classer les systèmes d’IA en quatre niveaux de risque et de les réglementer en fonction de cette classification.

Graphique : Maja Vilmark. Source : Commission européenne.

Un autre exemple est la proposition d’interdire l’utilisation des systèmes d’IA de reconnaissance faciale dans les lieux publics.

– Si on l’interdit, on développera d’autres outils qui reconnaissent les gens, par exemple en se basant sur leur façon de marcher. Ce n’est pas par des spécifications techniques que nous protégerons les droits fondamentaux des personnes, mais par une législation qui dit qu’ils ne doivent pas être violés. Les développeurs doivent alors garantir que leurs systèmes ne sont pas discriminatoires, par exemple.

Mais Virginia Dignum estime également que la Commission réglemente trop peu et ouvre des brèches dans la législation.

– Il n’est pas question de réglementer d’autres types de systèmes logiciels. Ils peuvent être tout aussi problématiques que ceux que nous appelons « IA ». Il est difficile de définir quels systèmes sont des IA et lesquels ne le sont pas. De même qu’il est difficile d’identifier exactement ce qui relève de l’IA dans les grands systèmes complexes.

Le professeur d’Umeå note qu’il existe déjà des lois qui peuvent s’appliquer à l’IA, comme la responsabilité du fait des produits, qui oblige les entreprises à retirer les biens ou les services dangereux.

– C’est leur responsabilité. L’IA elle-même ne peut être tenue pour responsable.

Note de bas de page : Dans le cas de l’Italie et du Chat GPT, l’autorité de protection des données du pays a interdit le chatbot jusqu’à ce que l’entreprise qui en est à l’origine informe les utilisateurs de la collecte de données et veille à ce que les enfants ne l’utilisent pas.

Faits.Intelligence artificielle, IA

L’objectif de l’intelligence artificielle est d’imiter artificiellement la capacité du cerveau à tirer des conclusions, planifier, résoudre des problèmes, acquérir de nouvelles connaissances, comprendre le langage naturel, etc.

L’IA est utilisée dans les véhicules autopilotés, pour analyser les images radiologiques et dans les « chatbots ».

La proposition législative de la Commission européenne a été présentée il y a deux ans. Les gouvernements des États membres ont adopté leur position en décembre.

Le 10 mai, deux commissions du Parlement européen adopteront les leurs. Plus tard en mai ou en juin, tous les députés européens devraient voter sur la proposition.

Les négociations entre les trois institutions de l’UE commenceront alors pour parvenir à un compromis commun.

Source : Encyclopédie nationale/Parlement européen

Erik est né et a grandi à Stockholm, en Suède, où il a passé la majeure partie de sa vie avant de venir vivre en France en 2018. Il est de langue maternelle suédoise et parle couramment francais. Il a obtenu un diplôme en communication et marketing à l’Université de Stockholm. Passioné par les voyages et la culture Suédoise, il aime partager les infos et valeurs de la Suède.